数据中心机柜热管理选型指南:应对AI算力激增挑战|实用指南

数据中心机柜热管理选型指南:应对AI算力功耗激增的挑战

引言

随着人工智能技术的快速发展,数据中心的AI算力功耗激增,给传统的散热系统带来了巨大挑战。如何在有限的空间内实现高效的热管理,成为数据中心建设和运维的关键问题。本文将从选型指南和参数对比的角度,深入探讨数据中心机柜热管理的解决方案。

机柜热管理面临的挑战

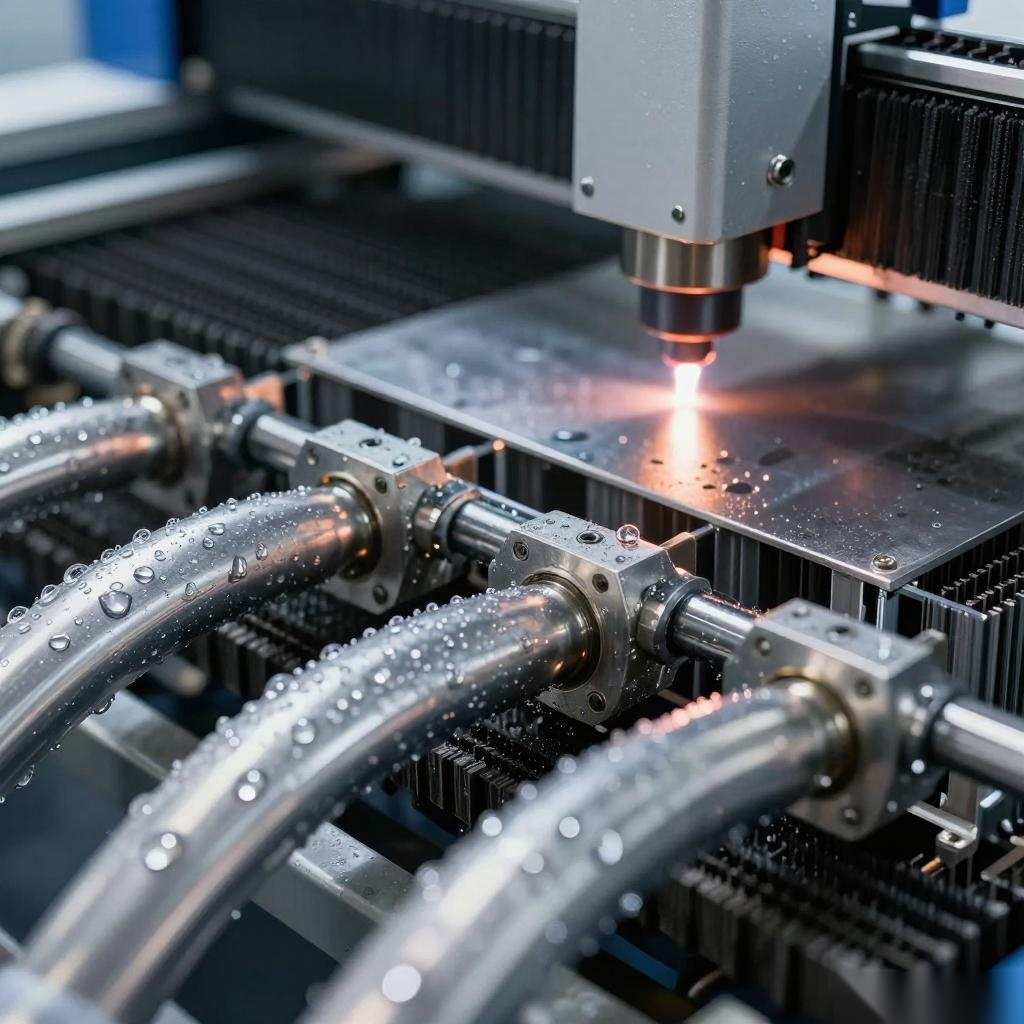

AI服务器的高功耗特性使得机柜内部热量急剧增加,传统的风冷散热方式已经难以满足需求。因此,数据中心需要采用更先进的热管理技术,如液冷系统和精密空调技术,以确保设备稳定运行。

关键挑战包括:高功耗密度、有限的空间、能效比要求、环境适应性等。这些挑战要求数据中心在选型时必须综合考虑多方面因素。

主流热管理技术对比

| 技术方案 | 特点 | 适用场景 | 能效比 |

|---|---|---|---|

| 风冷系统 | 成熟技术、易维护 | 中低密度机柜 | PUE1.5-2.0 |

| 液冷系统 | 高效散热、节能 | 高密度机柜 | PUE1.1-1.3 |

| 精密空调 | 精确控温、湿度控制 | 对环境要求高的场景 | PUE1.3-1.6 |

从表中可以看出,不同的热管理技术有各自的优缺点和适用场景。数据中心需要根据实际的业务需求和机柜密度选择合适的方案。

选型指南

- 评估机柜功耗密度:大于20kW的机柜建议采用液冷系统

- 考虑空间限制:紧凑型设计是关键

- 能效比要求:优先选择PUE低的方案

- 维护便捷性:模块化设计更受欢迎

在实际选型过程中,还需要考虑初期投资成本、运维成本以及可扩展性等因素。

总结与展望

综上所述,面对AI算力功耗激增的挑战,数据中心需要根据自身实际情况选择合适的机柜热管理方案。通过综合考虑功耗密度、空间限制、能效比等因素,可以实现高效、可靠的热管理。同时,随着技术的不断进步,未来将有更多创新的解决方案出现,如浸没式液冷等,为数据中心的发展提供更多可能性。

数据中心热管理是一个系统工程,需要从设备选型、系统设计到运维管理全方位考虑,才能真正实现高效、节能的目标。

上下篇导航